Chip đẩy nhanh sự phát triển của AI, và AI thúc đẩy sự tiến bộ của chip. Mới đây, thuật toán thiết kế chip AlphaChip của Google đã chính thức được trình làng.

CEO DeepMind Demis Hassabis nói đùa: Đây là một vòng khép kín.

Huấn luyện các thuật toán thiết kế chip tốt nhất → sử dụng chúng để thiết kế chip AI tốt hơn → sử dụng chúng để huấn luyện các mô hình tốt hơn → sau đó thiết kế chip tốt hơn →…

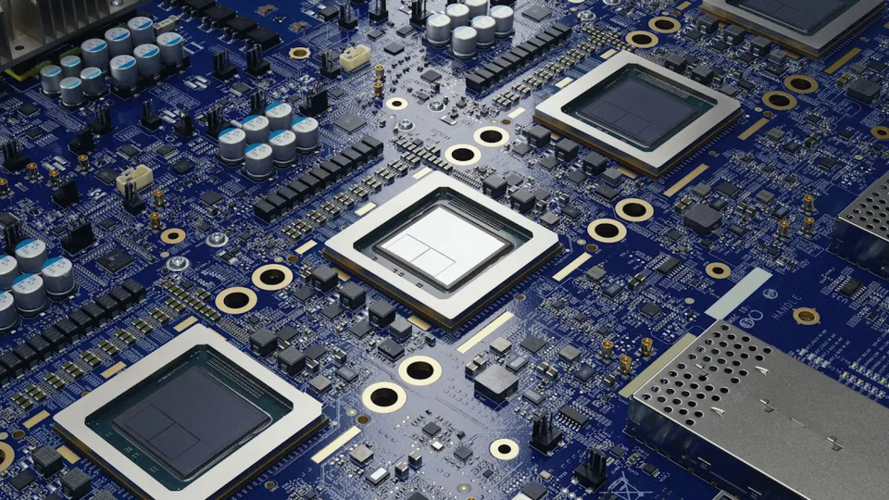

Google cho hay AlphaChip có thể tạo ra những thiết kế chip ngang tầm con người chỉ trong vài giờ. AlphaChip đã tham gia thiết kế TPU Trillium mạnh nhất hiện nay của Google và TPU đã đào tạo các thuật toán mới như Gemini, Imagen và Veo.

Các nhà sản xuất chip như MediaTek và Samsung cũng đã sử dụng nó trong sản xuất thực tế. Intel thì không, gần đây họ đang trong giai đoạn chuyển đổi khó khăn, đang bận rộn với các đàm phán mua bán và sáp nhập. Vì vậy cư dân mạng đã đưa ra ý kiến: Sao Google không mua Intel nhỉ?

Một hàng siêu máy tính tăng tốc AI Cloud TPU v5p trong trung tâm dữ liệu của Google.

Google cho biết AlphaChip giờ đây không chỉ nhanh hơn mà còn yêu cầu ít tài nguyên máy tính hơn và đã đạt đến trình độ chuyên gia về con người. Trong bản phát hành mới nhất, Google còn open source phiên bản pre-training để mọi người có thể sử dụng AlphaChip phát triển chip dễ dàng hơn (nhưng tốt hơn hết là bạn nên tự đào tạo trước).

Hoàn thành thiết kế chip AI trong vài giờ

Nhìn lại, kết quả sớm nhất của AlphaChip đã được công bố dưới dạng bản in sơ bộ vào năm 2020 và được công bố trên tạp chí Nature vào năm 2021. Nhưng phải đến hôm nay Google mới đặt cho nó một cái tên chính thức. Jeff Dean là một trong những tác giả.

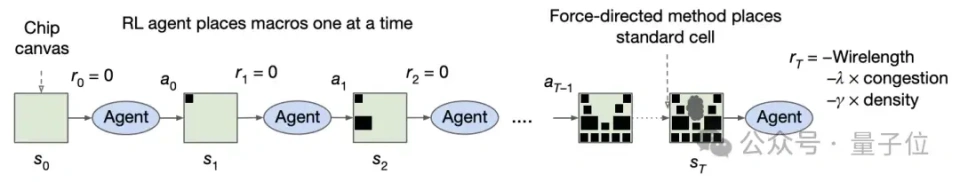

AlphaChip có các nguyên tắc tương tự như AlphaGo và AlphaZero, cả hai đều dựa trên học tập tăng cường sâu. AlphaZero đã nắm vững luật chơi cờ vây và cờ vua, đồng thời AlphaChip coi việc lập kế hoạch bố trí quân cờ như một trò chơi.

Một con chip thường chứa hàng tỷ bóng bán dẫn và hàng chục triệu cổng logic được tạo thành từ chúng là các đơn vị tiêu chuẩn. Ngoài ra, còn có hàng nghìn khối bộ nhớ, được gọi là macroblock. Thiết kế chip liên quan đến việc xác định vị trí của chúng. Cách chúng được bố trí sẽ ảnh hưởng đến tốc độ xử lý và hiệu suất sử dụng năng lượng của chip.

Trong phương pháp truyền thống, chỉ cần đặt các khối macro là rất tốn thời gian. Để có nhiều không gian hơn cho các ô tiêu chuẩn, mỗi lần lặp lại phải mất vài ngày hoặc thậm chí vài tuần.

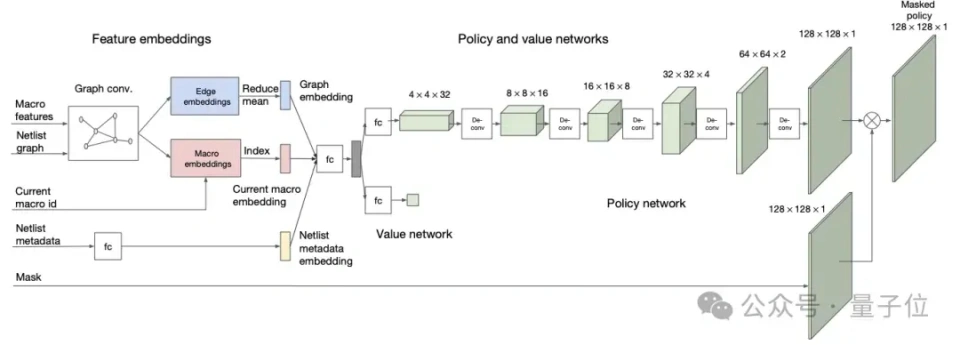

Dựa trên phương pháp học tăng cường sâu, AlphaChip học hỏi từ các bố cục chip trước đó và tạo ra các giải pháp thiết kế mới. Nó ánh xạ các ô macro và ô tiêu chuẩn lên một khung vẽ phẳng, tạo thành một “danh sách mạng chip” với hàng triệu đến hàng tỷ nút.

Bắt đầu từ một lưới trống, đặt từng thành phần mạch một cho đến khi tất cả các thành phần đã được đặt. Thuật toán sẽ tối ưu hóa công suất, hiệu suất và diện tích (PPA), v.v. và đưa ra phân bố xác suất. Phần thưởng cuối cùng sẽ được tính toán dựa trên chất lượng bố cục.

AlphaChip, mạng thần kinh đồ thị dựa trên cạnh mới, có thể tìm hiểu mối quan hệ giữa các thành phần chip được kết nối với nhau và áp dụng nó giữa các chip, do đó AlphaChip có thể cải thiện mọi bố cục của thiết kế.

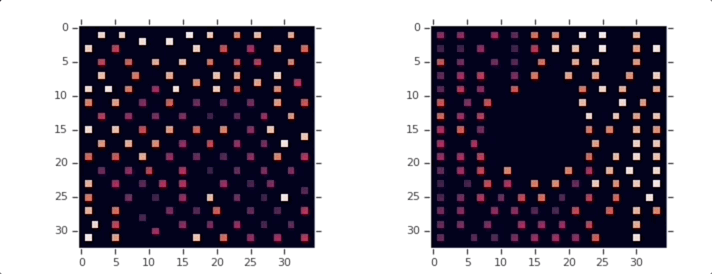

Trong hình bên dưới, hình bên trái hiển thị kết quả của CPU Ariane RISC-V nguồn mở bố trí AlphaChip dưới các mẫu 0 và hình bên phải cho thấy hiệu quả của việc tinh chỉnh dựa trên chiến lược đào tạo trước (thiết kế 20 TPU).

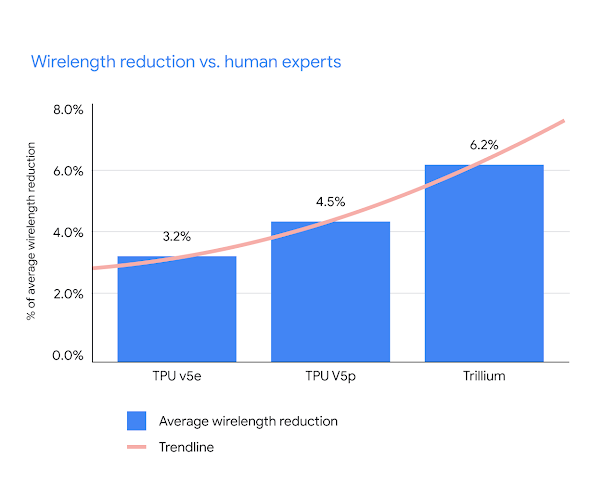

Sau nhiều lần lặp lại, hiệu quả và tốc độ thiết kế chip hiện tại của AlphaChip đã được cải thiện đáng kể so với trước đây, đạt đến trình độ tương đương với các chuyên gia về con người.

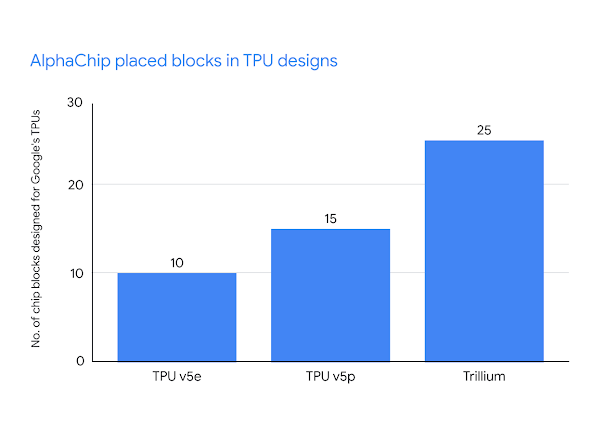

Google dẫn chứng việc AlphaChip tham gia thiết kế TPU v5e, TPU v5p và Trillium, hiện là 3 chip điện toán AI tiên tiến nhất của Google.

Biểu đồ thanh hiển thị số lượng khối chip được AlphaChip thiết kế qua ba thế hệ Bộ xử lý Tensor (TPU) của Google, bao gồm v5e, v5p và Trillium.

Biểu đồ thanh cho thấy độ giảm chiều dài dây trung bình của AlphaChip qua ba thế hệ Bộ xử lý Tensor (TPU) của Google, so với vị trí do nhóm thiết kế vật lý TPU tạo ra.

Chip thiết kế AI đang trở thành một mô hình mới

Điều đáng nói là đội ngũ AlphaChip đã từng tham gia vào các vụ việc chống hàng giả trước đây. Nhân viên Google Brain Satrajit Chatterjee đã đặt câu hỏi nội bộ rằng bài báo của nhóm được xuất bản trên tạp chí Nature là không thể kiểm chứng được và các thí nghiệm chưa được kiểm tra đầy đủ. Vào tháng 3/2022, nhà nghiên cứu này đã bị Google sa thải. (Đây có thể là một trong những lý do khiến AlphaChip chưa được phát hành chính thức?)

Tuy nhiên, không chỉ Google mới sử dụng AI để thiết kế chip. H100 của Nvidia cũng có AI tham gia vào thiết kế. Bằng cách sử dụng các tác nhân học tăng cường sâu để thiết kế mạch, gần 13.000 mạch trong H100 được thiết kế bởi AI.

Trước đó, Samsung cũng bị phát hiện sử dụng DSO.ai của Synopsys để thiết kế bộ xử lý Exynos. Vào thời điểm đó, Synaptics tự hào nói rằng DSO.ai là phần mềm AI thương mại đầu tiên dành cho thiết kế bộ xử lý.

Cùng với xu hướng Generative AI, Cadence cũng đang thúc đẩy các chip thiết kế AI và tung ra giải pháp Tối ưu hóa AI. Và còn có Cadence Copilot, sử dụng các mô hình ngôn ngữ lớn (LLM) và các mô hình cơ bản khác để cải thiện đáng kể năng suất của kỹ sư.

Tuyên bố miễn trừ trách nhiệm: Thông tin được cung cấp chỉ mang tính chất thông tin chung, https://lacongnghe.com không đưa ra bất kỳ tuyên bố hoặc bảo đảm nào liên quan đến thông tin, bao gồm nhưng không giới hạn bất kỳ sự tuyên bố hoặc bảo đảm về tính thích hợp cho bất kỳ mục đích cụ thể nào của thông tin theo phạm vi cho phép tối đa của pháp luật. Mặc dù đã nỗ lực để đảm bảo rằng thông tin được cung cấp trong bài viết này là chính xác, đáng tin cậy và hoàn chỉnh vào thời điểm đăng tải, nhưng thông tin được cung cấp trong bài viết này không nên được dựa vào để đưa ra bất kỳ quyết định tài chính, đầu tư, bất động sản, giao dịch hoặc pháp lý nào. Thêm vào đó, thông tin không thể thay thế lời khuyên từ một chuyên gia được đào tạo, người mà có thể xem xét, đánh giá các sự kiện và hoàn cảnh cá nhân của bạn, và chúng tôi không chịu bất kỳ trách nhiệm nào nếu bạn sử dụng những thông tin này để đưa ra quyết định. Xin cảm ơn!